<概要>

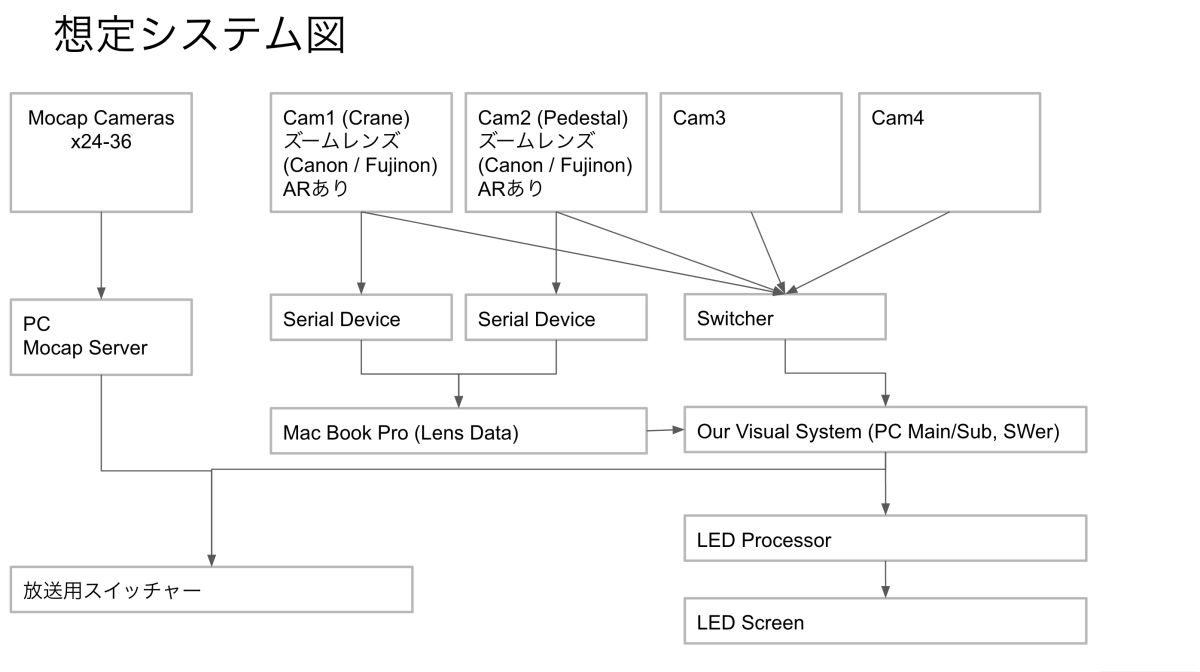

Dynamic VR++はライゾマティクス が独自に開発したシステムです。立体錯視可能な3面LED (Dynamic VR Display)と、その3面LEDのグラフィックと同期し物理LEDを拡張するAR映像表現を可能にします。カメラの位置に合わせて3面LEDの映像を適切に歪め、スイッチャー同期を行うことで常にアクティブなカメラからの立体視が可能になります。また、光学式モーションキャプチャーシステム(VICON / OptiTrack)と連動し、ズームレンズ(Canon / Fujinon)にも対応するAR映像表現を実現します。

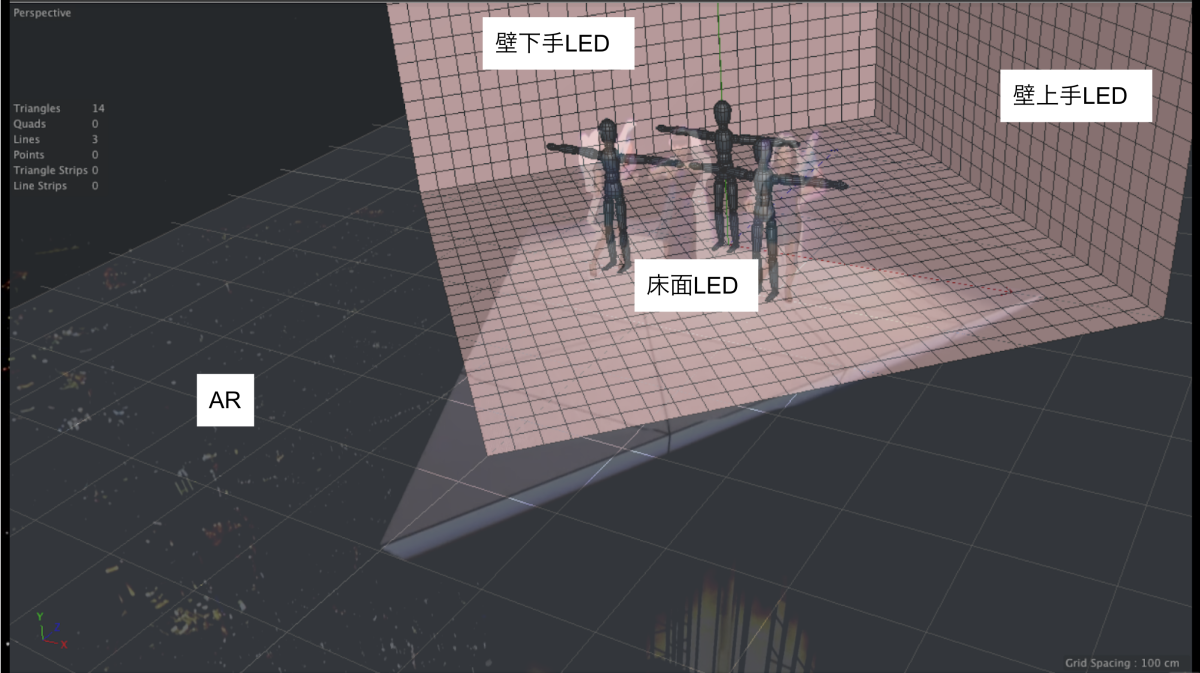

<構成要素1> 立体錯視可能な3面LED (Dynamic VR Display)

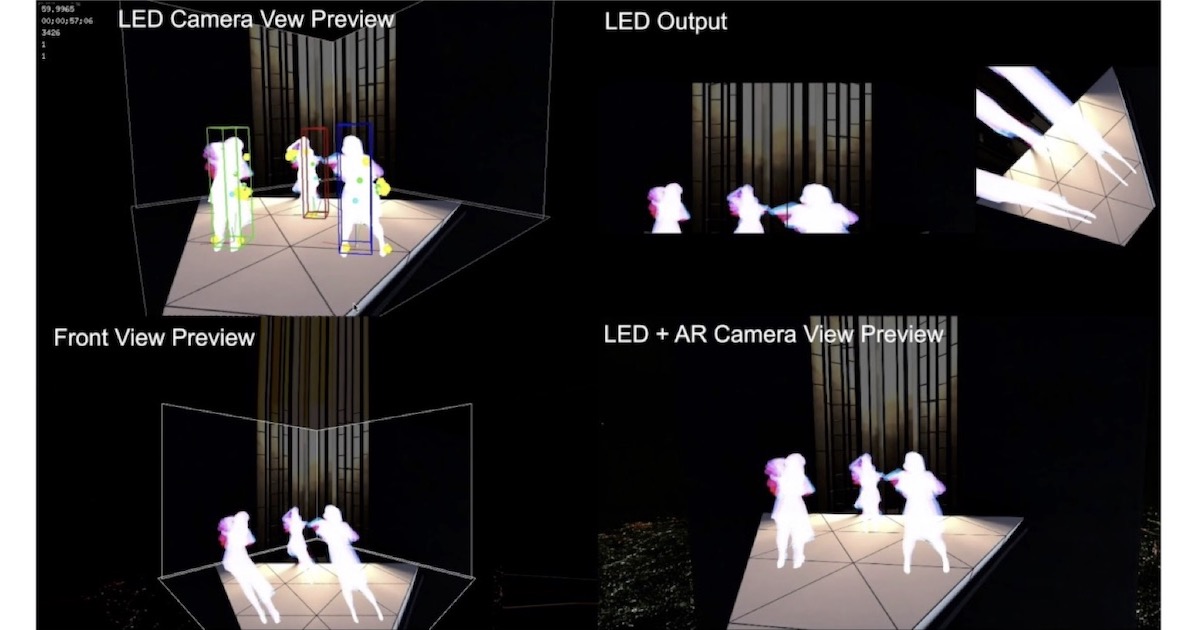

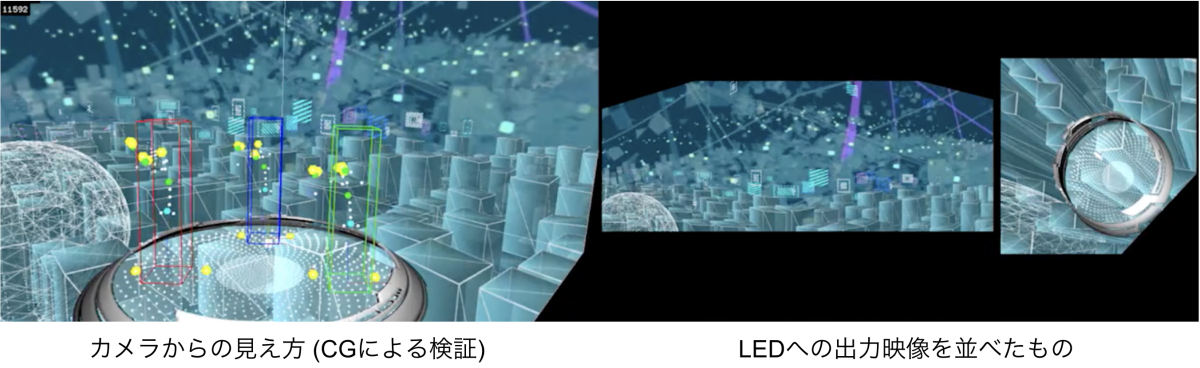

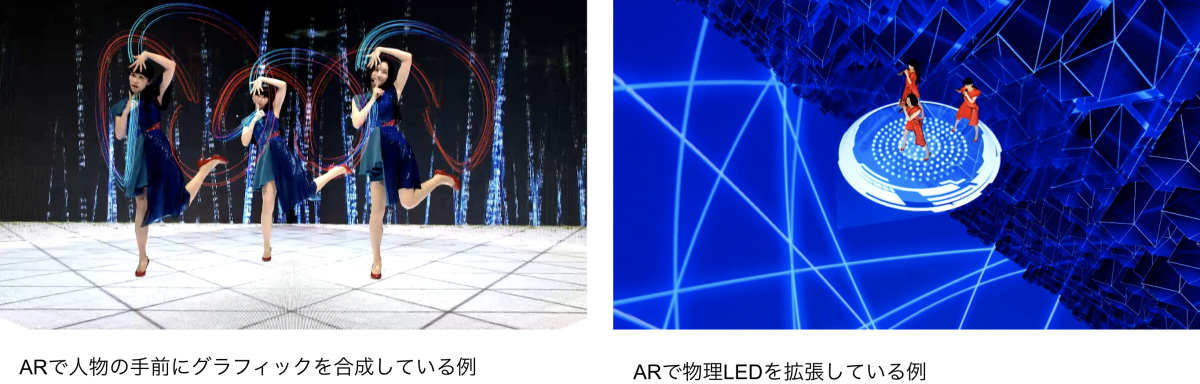

ステージの床面や背面のLEDディスプレイに表示される映像を、トラッキングされたカメラの位置情報に応じて適切に歪ませることで、移動視差による立体感のある映像演出が可能になります。複数台のカメラのスイッチングとも連動してLED映像のパースを切り替えることでテレビ中継などでも破綻のない演出が可能であり、さらに現実のLEDディスプレイがカバーできない領域はリアルタイムAR合成をすることで、バーチャルセットでのライブパフォーマンスが可能となります。グリーンバックによるバーチャルセットと違い、リアルスペースの観客にも歪んではいるもののLEDディスプレイの映像は視認できるので、現実空間でもある程度の演出性が保証されます。

<構成要素2> リアルタイム AR システム

VICON、OptiTrackといった光学式モーションキャプチャシステムを利用し、カメラに反射マーカーを装着しトラッキングすることで、高精度な可動カメラのARを実現させます。Fujinon、Canonのズームレンズプロトコルに対応し、放送用カメラを使用することが可能で、各ズームで適切な歪み補正を行うことでズレのないARを実現します。一般的な業務用バーチャルスタジオと同等以上の性能となっています。上記ズームレンズの汎用キャリブレーションシステムによって、新規レンズにも柔軟に対応可能です。カメラ映像は5GHz帯の無線で送受信することで、カメラ側は完全ワイヤレスでのオペレーションが可能となります。映像出力はopenFrameworksでシステムの基盤を開発し、Spout/NDIなどのテクスチャ共有システムと連携することで、Notch/Unreal Engineなどのレンダリングエンジンに対応可能です。スイッチャーの制御も含め、複数カメラ入力に対応した独自システムとなっているため、Seamless Mixed Realityなどの高度な表現の統合が容易となります。

<その他>

①AR合成精度

スタジオで利用する大部分のカメラで、実オブジェクトとの誤差数mm以内での合成が可能です。

目安:B4レンズ 4.5mm~50mm程度まで(35mm換算で16mm~180mm相当)。B4レンズ50mm以上で可動の場合実オブジェクトと誤差数cm以内での合成が可能です。

②照明、音響

DMX, MIDI制御での連動が可能です。

③同期機能

タイムコードでの同期が可能です。